Рубрика оценки промптов в prompt engineering для enterprise

Дополнительные советы по разработке рубрики оценки промптов для генерации персонализированного контента в enterprise. Метрики для LLM, качественные и количественные измерения, отслеживание ошибок, LLM-as-judge и интеграция в CI/CD для объективной llm evaluation.

Какие дополнительные советы по разработке всесторонней рубрики оценки для промптов, генерирующих персонализированный динамический контент в масштабе в enterprise-организациях? Какие ключевые практики для объективной оценки точности выводов, включая определение метрик, разделение качественных измерений и отслеживание ошибок?

Для разработки всесторонней рубрики оценки промптов в prompt engineering для enterprise-организаций, генерирующих персонализированный динамический контент, комбинируйте метрики для llm вроде accuracy, relevance, F1-score и coherence, разделяя их на качественные (LLM-as-judge, human review) и количественные (BLEU, ROUGE). Ключ к объективности — в создании золотых датасетов с 50–100 тестовыми кейсами, включая edge cases, и реал-тайм мониторинге ошибок через CI/CD с алертами. Это позволит отслеживать галлюцинации, bias и регрессии, обеспечивая масштабируемость в продакшене.

Содержание

- Введение в prompt engineering и llm evaluation для enterprise-организаций

- Определение метрик для llm в prompt engineering guide

- Разделение качественных и количественных измерений точности

- Создание датасетов и тестовых кейсов для ai prompt engineering

- LLM-as-judge и автоматизированные практики оценки

- Отслеживание ошибок и мониторинг в продакшене

- Интеграция в CI/CD и MLOps для prompt engineer

- Рекомендуемые инструменты и лучшие практики prompt engineering для ии

- Источники

- Заключение

Введение в prompt engineering и llm evaluation для enterprise-организаций

Представьте: ваша ai prompt engineering система генерирует тысячи персонализированных рекомендаций в секунду для миллионов пользователей. А что если один неверный промпт вызовет каскад галлюцинаций? В enterprise это не шутки — потери репутации и дохода.

Здесь на помощь приходит рубрика оценки: системный подход к llm evaluation, где вы определяете, насколько выводы точны, релевантны и безопасны. По данным экспертов из Datadog, начинать стоит с бизнес-целей — NPS, CSAT или retention, — а не абстрактных метрик. Для динамического контента рубрика должна эволюционировать: от офлайн-тестов к онлайн-мониторингу.

Почему это критично для масштаба? Промпты мутируют под пользователя, контекст меняется — статическая оценка не сработает. Нужно 360-градусное покрытие: метрики, датасеты, судьи и трассировка.

Определение метрик для llm в prompt engineering guide

Метрики — фундамент рубрики. Без них prompt engineering guide превращается в гадание на кофейной гуще. Начните с базового набора: accuracy (доля верных ответов), precision/recall/F1 (для извлечения фактов) и relevance (соответствие запросу).

Для генеративного контента добавьте coherence (логичность текста), factual correctness (отсутствие вымысла) и groundedness (опора на источники). В AI Academy подчеркивают: для персонализации метьте bias и toxicity, особенно в enterprise с чувствительными данными.

А как насчет нишевых? Для SQL-генерации — exact match, для чат-ботов — chain-of-thought quality. Цель — 10–15 метрик, привязанных к промпту. Тестируйте на шкале 0–1 или бинарно, чтобы избежать субъективности.

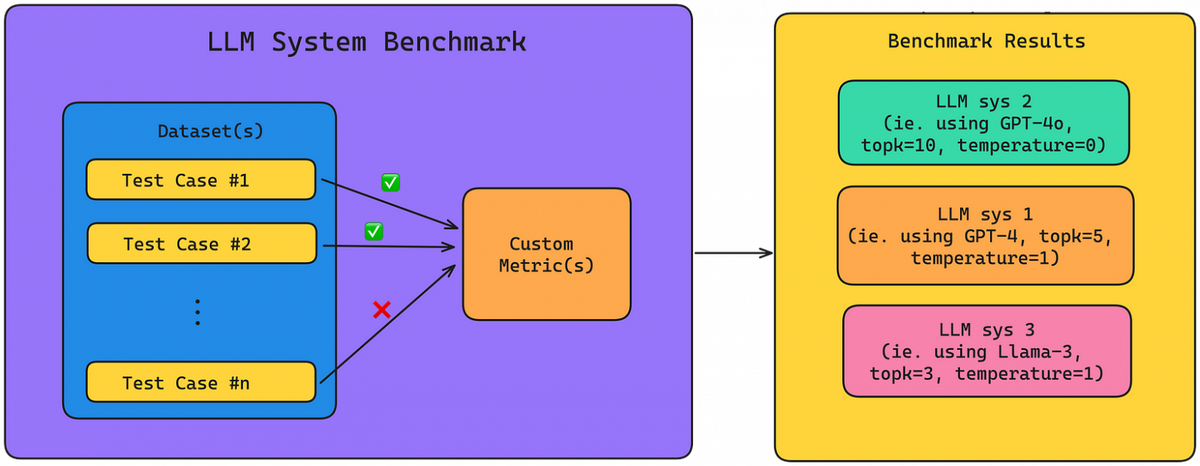

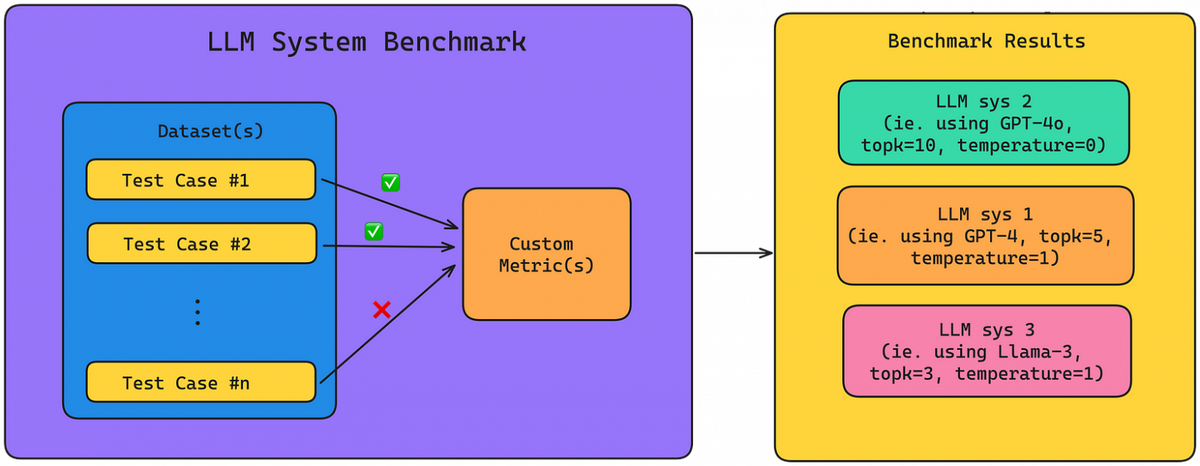

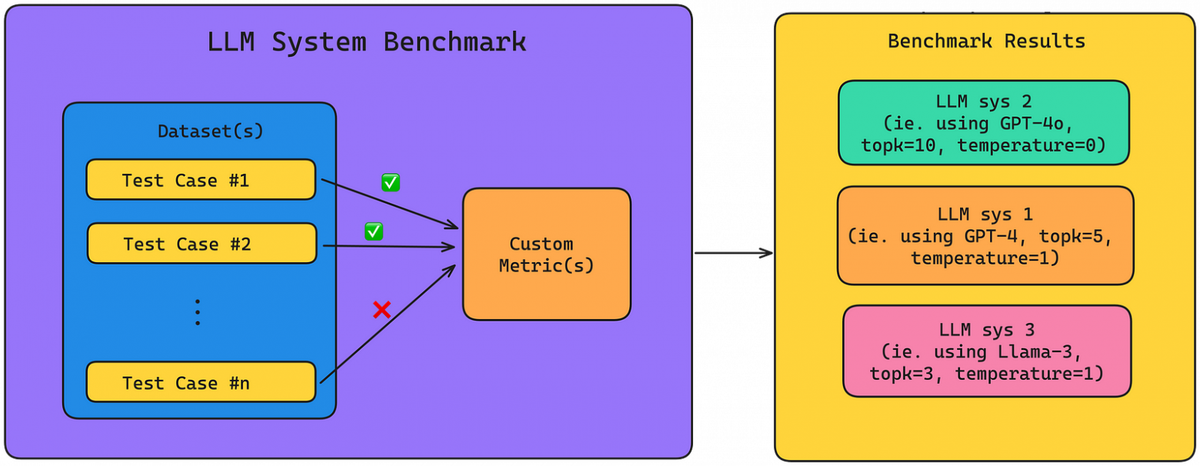

Эта диаграмма из Хабр показывает, как метрики вписываются в полный цикл: от датасета к CI/CD.

Разделение качественных и количественных измерений точности

Не все метрики равны. Количественные — это автоматика: BLEU/ROUGE для сходства с ground truth, Perplexity для fluency, BERTScore для семантики. Они быстрые, воспроизводимые, идеальны для A/B-тестов.

Качественные сложнее: faithfulness (верность источникам), helpfulness (полезность). Здесь ручной review или LLM-as-judge спасает, но с рубрикой: шкала 1–5 с критериями (например, “0 — полная галлюцинация, 5 — идеальная опора на факты”). SuperAnnotate рекомендует hybrid: 80% авто + 20% human для калибровки.

В enterprise разделите по этапам: офлайн (количественные на golden set), онлайн (качественные через семплы). И не забудьте веса — relevance может быть 40%, safety 30%.

Но вот вопрос: как избежать дрейфа? Регулярно калибруйте на новых данных.

Создание датасетов и тестовых кейсов для ai prompt engineering

Без датасета рубрика — пустой звук. Старт: 50–100 пар (промпт, ground truth, контекст). Покройте типы: типичные запросы, edge cases (редкие сценарии, adversarial атаки), персонализацию (user profile + история).

Galileo.AI советует аннотировать вручную: 3–5 экспертов на кейс для inter-annotator agreement >0.8. Синтезируйте данные через self-instruct или парафразинг — это ускорит рост до тысяч тестов.

Для динамики добавьте шаблоны: “user_id: {id}, context: {dynamic}”. Тестируйте на needle-in-haystack (инъекция фактов в шум). Храните в JSON/CSV, версионируйте в Git.

Результат? Регрессионные тесты, ловящие поломки при апдейтах промптов.

LLM-as-judge и автоматизированные практики оценки

Человеческий review не масштабируется. Врывается LLM-as-judge: GPT-4 или Claude оценивают вывод по рубрике. G-Eval из Хабр — топ: генерирует score + объяснение за секунды.

Практика: промпт-джадж с chain-of-thought (“Шаг 1: проверь факты…”). Коррелирует с human на 90%+. Для объективности — ротация моделей (не та же, что генерит).

Автоматизация: скрипты на Python, threshold для флага (score <0.7 — алерт). В enterprise комбинируйте с distillation: лучшие промпты обучают меньшие модели.

Звучит просто? Но калибруйте на вашем домене — универсальные джаджи слепы к нюансам.

Отслеживание ошибок и мониторинг в продакшене

Ошибки — норма. Галлюцинации, PII-утечки, off-topic. Рубрика фиксирует типы: classify по категориям (factual error, bias, toxicity).

Gimal-Ai через LangSmith: логируйте все вызовы, семплируйте 1–5%, применяйте метрики реал-тайм. Алерты в Slack при дрейфе >10%.

Мониторинг: dashboards с трендами (accuracy по пользователям/регионам). Root cause: трассировка промпта → RAG → вывод. Для динамики — cohort analysis (новые vs старые юзеры).

Без этого enterprise слепо.

Интеграция в CI/CD и MLOps для prompt engineer

Рубрика без пайплайна — хобби. Интегрируйте в GitHub Actions/Jenkins: тест промпта → eval на датасете → deploy если pass rate >95%.

MLOps: версионинг промптов (PromptFlow), A/B в prod, rollback на регрессию. Datadog подчеркивает observability: spans для latency + quality.

Для масштаба — distributed eval на Kubernetes. Prompt engineer становится data scientist: итерации на основе метрик.

Готовы к промпт-DevOps?

Рекомендуемые инструменты и лучшие практики prompt engineering для ии

Promptfoo — CLI для локальных тестов, DeepEval — синтетика датасетов. LangSmith — full observability с кастом evaluators. Galileo Luna — agent-specific метрики.

Лучшие практики: weekly benchmarks, human loop quarterly, tie-breaking для споров. Обучайте команду — prompt engineering для ии как skill.

Избегайте over-engineering: стартуйте с 5 метрик, масштабируйте.

Источники

- Хабр — Практика оценки промптов и метрик для LLM в enterprise с G-Eval и CI/CD: https://habr.com/ru/articles/874538/

- AI Academy — Evals OpenAI: метрики accuracy, F1, LLM-as-judge и датасеты: https://aiacademy.me/tpost/b3hb24lt11-otsenki-evals-openai-na-praktike-uchimsy

- Gimal-Ai — LangSmith для мониторинга ошибок и кастомных evaluators в проде: https://gimal-ai.ru/blog/platforma-dlya-monitoringa-i-otladki-llm-prilozheniy/

- Datadog — Фреймворк llm evaluation: метрики faithfulness, human-in-the-loop: https://www.datadoghq.com/blog/llm-evaluation-framework-best-practices/

- Galileo.AI — Шаговый гид по оценке с бизнес-метриками и edge cases: https://galileo.ai/blog/llm-evaluation-step-by-step-guide

- SuperAnnotate — Гайд по метрикам Perplexity, BLEU и типам ошибок: https://www.superannotate.com/blog/llm-evaluation-guide

Заключение

Разработка рубрики для prompt engineering в enterprise — это баланс метрик для llm, датасетов и мониторинга, где llm evaluation эволюционирует с вашим трафиком. Начните с core: accuracy + relevance, добавьте LLM-as-judge и CI/CD — и ваш динамический контент станет надежным. Регулярные итерации сделают ai prompt engineer героем команды, минимизируя риски в масштабе.

В prompt engineering для enterprise важно комбинировать офлайн-оценку с реал-тайм мониторингом, начиная с 50–100 тестовых кейсов (вход, ground truth, контекст) и расширяя синтетикой через DeepEval.

Метрики для LLM должны покрывать корректность, релевантность, достоверность (качественные) и контекстную полноту, точность SQL (количественные), разделяя по компонентам (извлечение, генерация). Для объективности используйте LLM-as-judge (G-Eval) для автоматической оценки, логируйте ошибки и интегрируйте в CI/CD для регрессионных тестов. Регулярно обновляйте бенчмарки для персонализированного динамического контента в масштабе.

Для ai prompt engineering в enterprise определите метрики: accuracy, precision, recall, F1, BLEU/ROUGE (количественные) и groundedness, bias, chain-of-thought quality (качественные).

Создавайте детерминированные evals с моделью-судьей (GPT-4), датасеты с edge cases и ручной аннотацией ground truth.

Разделите оценку на автоматический скрипт, LLM-as-judge и human-in-the-loop для объективности, итеративно анализируя ошибки.

Используйте promptfoo для автоматизации, мониторьте в проде и применяйте distillation для улучшения промптов в llm evaluation.

В prompt engineering guide для enterprise используйте LangSmith с метриками accuracy, relevance, coherence, factual correctness, кастомными evaluators.

Разделите на количественные (автоматические) и качественные (ручная аннотация) измерения, тестируя на dataset с ожидаемыми ответами.

Отслеживайте ошибки через прод-мониторинг, алерты в Slack/Telegram, интегрируя в CI/CD для фикса регрессий и сравнения версий в llm evaluation.

Для llm evaluation в enterprise определите метрики: accuracy, topic relevancy, toxicity, negative sentiment, faithfulness.

Используйте code-based тесты (needle-in-the-haystack), LLM-as-judge и human-in-the-loop с golden датасетом.

Разделите качественные (шкалы 0-1) и количественные (бинарные) измерения, отслеживая ошибки через мониторинг, алерты и трассировку для реал-тайм реакции в prompt engineering.

В ai prompt engineer для enterprise свяжите метрики с бизнес-целями (NPS, CSAT), комбинируя офлайн/онлайн оценку, A/B-тесты.

Собирайте датасеты с edge cases, аннотируя ground truth; метрики: reference-free (Perplexity), agent-specific, safety (PII, bias).

Отслеживайте ошибки реал-тайм guardrails, автоматизируя с Luna-2 в MLOps для непрерывного улучшения в prompt engineering for llms.

Разработайте рубрику с метриками Perplexity, BLEU, ROUGE, F1, BERTScore, разделяя на языковые, бизнес- и safety-категории.

Для объективности комбинируйте LLM-as-judge и human оценку, логируя ошибки по типам (токсичность, галлюцинации).

Регулярно обновляйте golden тесты, анализируя расхождения для динамического контента в метрики оценки llm.